执行摘要:

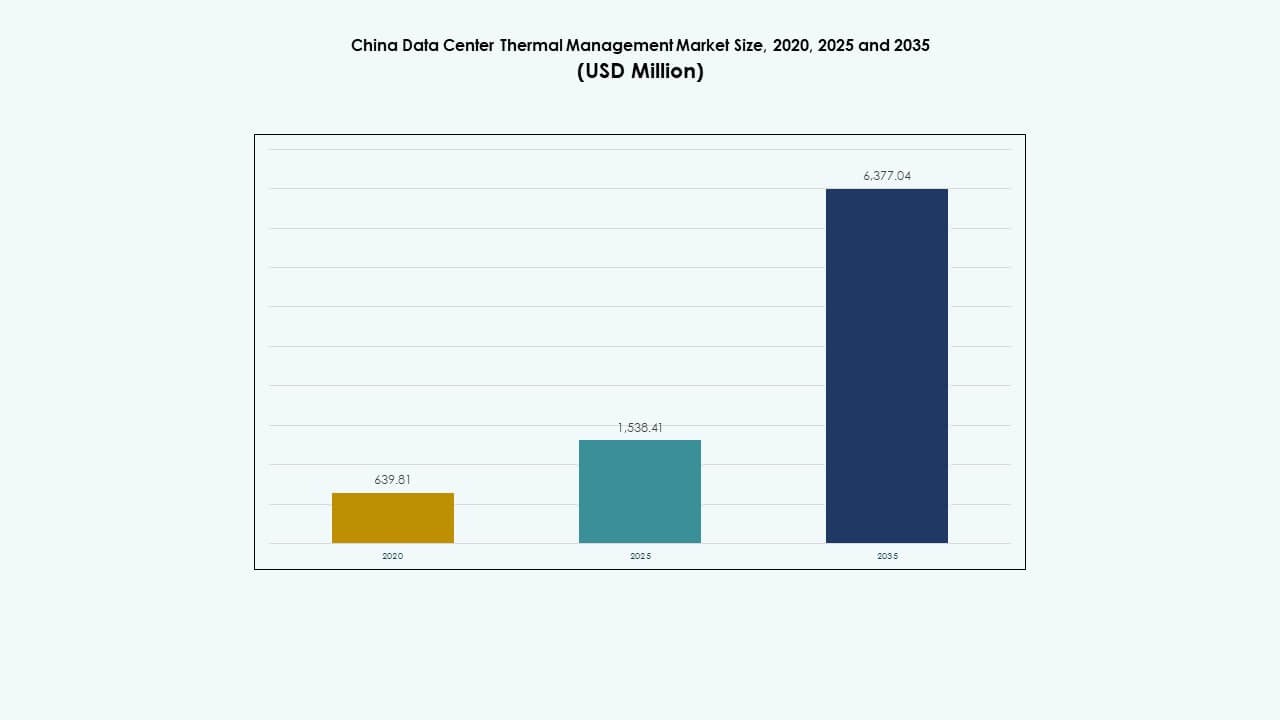

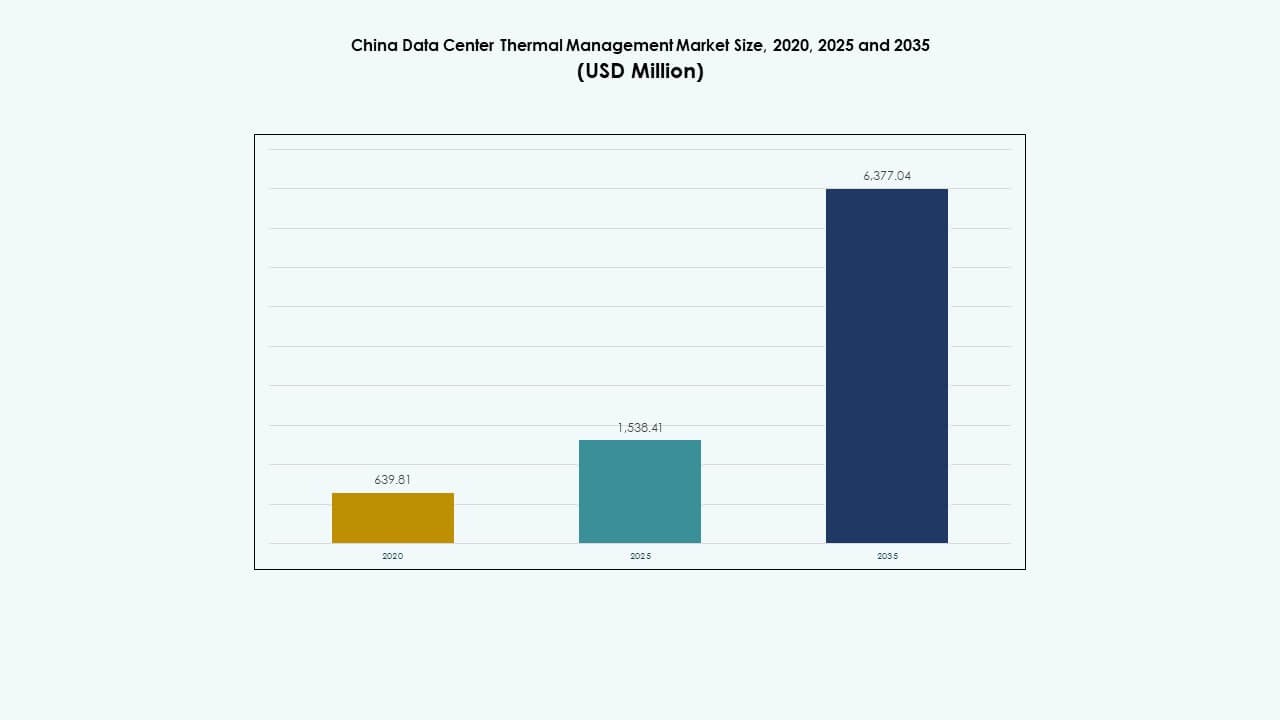

中国数据中心热管理市场规模在2020年估值为6.3981亿美元,2025年增长至15.3841亿美元,预计到2035年将达到63.7704亿美元,预测期内的复合年增长率为15.10%。

| 报告属性 |

详细信息 |

| 历史时期 |

2020-2023 |

| 基准年 |

2024 |

| 预测期 |

2025-2035 |

| 2025年中国数据中心热管理市场规模 |

15.3841亿美元 |

| 中国数据中心热管理市场,复合年增长率 |

15.10% |

| 2035年中国数据中心热管理市场规模 |

63.7704亿美元 |

高密度AI和HPC服务器的部署正在改变中国数字基础设施的热管理格局。政府政策强制执行更低的PUE阈值,推动运营商采用液体冷却、混合系统和AI驱动的气流优化工具。超大规模设施越来越多地集成直芯片和浸没式冷却以控制不断上升的电力负载。“东数西算”政策进一步推动市场发展,将计算需求转向气候友好的内陆省份。这些变化为热解决方案供应商和投资者带来了长期战略相关性。

由于企业和托管数据中心的密集分布,华东地区在市场中占据主导地位。北京、上海和杭州等城市因数字化转型、AI部署和监管压力而领先采用。贵州和内蒙古等西部和北部省份因较冷的气候和可再生能源的获取而成为热创新区。深圳和广州等南部枢纽由于持续的超大规模云扩展和城市边缘部署仍然是关键。

市场动态:

市场驱动因素

对能源效率和全国PUE目标的强力政策推动,覆盖一级和二级数据中心

中国数据中心热管理市场受益于明确的监管推动,旨在减少能源消耗。国家级指令如工信部2021年行动计划要求到2025年平均PUE低于1.5。北京和上海的数据中心面临更严格的城市级目标。运营商已采用高效冷却系统以符合这些不断变化的标准。液体和混合冷却技术在超大规模项目中获得关注。地方政府鼓励可再生能源和可持续设计的整合。这些政策为热系统制造商创造了显著的商业机会,帮助投资者识别与合规驱动升级相关的稳定收入渠道。通过与政府指令保持一致,企业在该领域获得战略优势。

- 例如,中国的绿色数据中心行动计划要求到2025年,新建的大型和超大型数据中心的PUE必须低于1.3,鼓励使用先进的冷却技术和节能设计。此要求与国家提高数据中心能源性能和降低碳强度的目标一致。

由AI和HPC工作负载驱动的高密度计算负载在中国主要枢纽的采用

人工智能、机器学习和高性能计算的激增推动了热基础设施的极限。与传统系统相比,GPU密集型服务器机架产生的热量显著增加。中国的云计算巨头和AI初创公司正在核心地区扩展大型训练集群。为了保持热稳定性,数据中心部署了浸没式和直芯片冷却等先进冷却技术。传统的空气冷却无法满足这些AI密集环境的效率标准。市场供应商迅速创新以支持每机架20-30 kW的密度场景。随着热负荷密度的上升,中国数据中心热管理市场也在增长。这些技术转变创造了对自适应、模块化和可扩展热系统的需求。投资者在具有强大液冷能力的公司中发现了价值。

在国家“东数西算”战略下的超大规模数据中心投资扩张

中国的国家战略将计算负载从沿海城市分散到内陆省份。甘肃、贵州和内蒙古等省份以优惠的电价和土地供应吸引超大规模项目。这些新的数据中心枢纽需要专门为寒冷气候和低湿度设计的冷却方案。运营商实施环境空气节能器和后门热交换器以实现节能性能。迁移趋势减少了沿海电网的压力,并与可再生能源的整合相一致。中国数据中心热管理市场正在发展,以支持大规模、区域特定的冷却部署。这种地理再平衡扩大了供应商生态系统,并推动了对区域优化热硬件的需求。战略投资者寻求支持那些位于内陆超大规模区域附近的供应商。

- 例如,中国的“东数西算”计划在西部省份建立国家计算枢纽,以将数据处理从东部转移。这些枢纽利用可再生能源和较凉爽的气候来提高能源效率,并支持更严格的PUE目标。

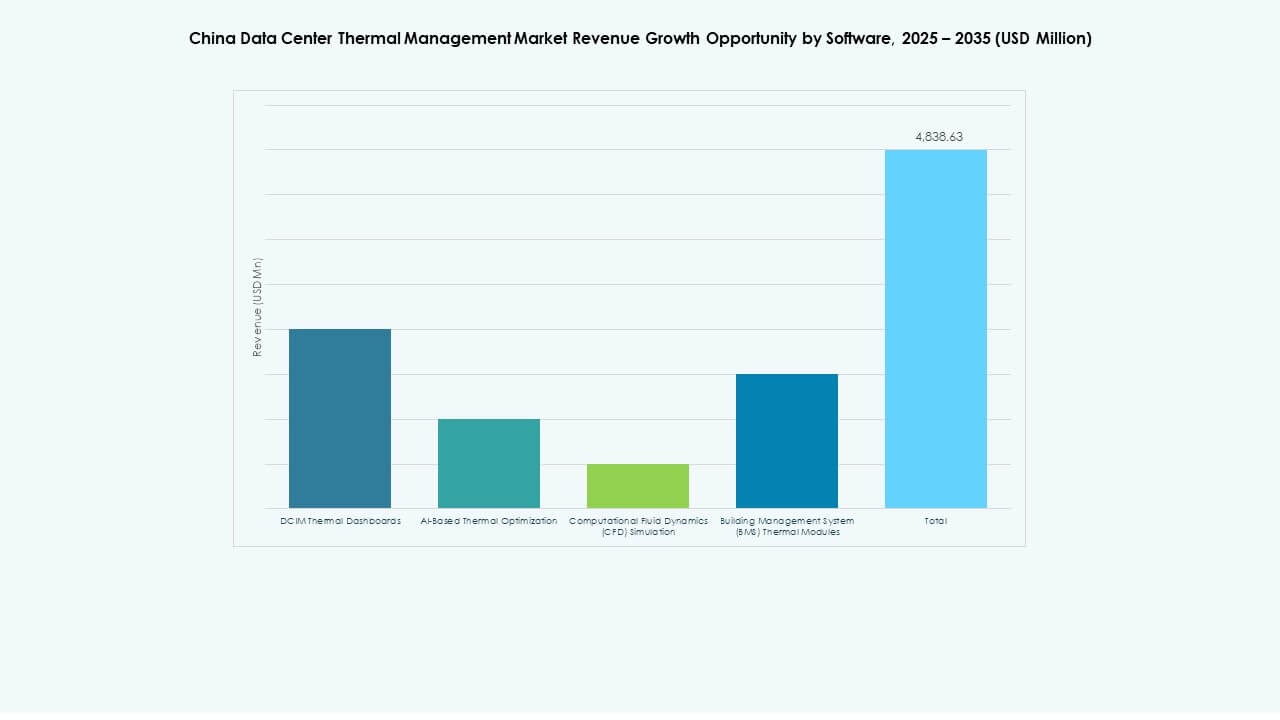

智能控制和AI驱动的优化系统集成以提升冷却性能

热管理现在不仅限于硬件,还包括软件定义的智能。中国领先的托管和企业玩家采用AI驱动的冷却平台,动态管理能源。DCIM、BMS模块和CFD工具等系统分析气流并自动调节风扇速度。这些工具提高了热效率,同时降低了电力成本。实时传感器捕捉机架温度,预测分析微调冷却负载分配。中国数据中心热管理市场从IT和OT系统的融合中受益。软件定义的基础设施将传统冷却转变为自适应、智能系统。它为提供硬件和智能优化层的供应商创造了长期的黏性。

市场趋势

在高性能设施中增加后门和机架内液冷的部署

后门热交换器和机架内液冷系统在中国的超大规模和人工智能数据中心中越来越受欢迎。这些设置在源头上移除热量,降低了对传统全室气流的需求。它们受到计算密集型环境的青睐,在这种环境中空气冷却无法维持高效的温度。像阿里巴巴和腾讯这样的中国运营商实施后门系统以支持高密度训练集群。这些单元直接集成到机架中,提供局部的热量提取。中国数据中心热管理市场反映了对这些形式因素的需求增长。它们还通过减少冷水分配损失来降低能源使用。其模块化特性适合边缘和容器化设置。

极高密度AI和区块链数据中心的浸没式冷却采用率上升

浸没式冷却在高功率环境中看到更多部署,如加密货币挖矿、AI实验室和研究中心。整个服务器浸没在导热且不导电的液体中。这种方法消除了风扇,并显著提高了能源效率。初创公司和全球企业进入市场,提供单相和两相解决方案。中国的区块链运营商偏爱浸没式冷却,以降低运营成本并延长硬件寿命。中国数据中心热管理市场将这些设计整合到超大规模改造中。技术优势包括静音操作和每平方米更高的功率密度。部署成本仍然很高,但长期节省推动了采用。

使用预测分析进行冷却优化的智能热管理平台

AI和机器学习工具增强了大型园区热负载分布的精确性。预测模型根据工作负载类型、时间和气候条件预测冷却需求。运营商利用这些见解预先减少或增加特定区域的冷却。集成平台控制风扇速度,调整气流模式,并跟踪冷却单元性能。中国数据中心热管理市场接受这些软件进步以提高运营可靠性。这些系统降低了停机风险并延长了硬件寿命。国内外公司提供可叠加在现有基础设施上的模块化软件。可扩展性和供应商中立设计提升了其吸引力。

数据中心改造推动城市设施中混合冷却基础设施的增长

中国的城市数据中心面临空间限制,限制了完整冷却系统的全面改造。相反,运营商采用混合模式,将现有的空气冷却设置与液冷系统结合。直接芯片冷却或后门交换器改造到机架中,提高性能而无需结构重设计。这一趋势支持北京、广州和杭州等城市的灵活升级。中国数据中心热管理市场通过紧凑和可堆叠的冷却单元捕捉这一需求。混合设计在传统和下一代冷却之间提供了桥梁。供应模块化组件的供应商将在这一渐进过渡中受益。这些部署还帮助公司满足新的监管效率标准。

市场挑战

液体冷却和浸没式冷却技术的高初始资本支出

液体冷却系统效率高,但需要大量的前期投资。专业设备、安装劳动力和定制管道提高了安装成本。浸没式冷却设置由于密封罐和介电液体进一步增加了资本需求。由于投资回报周期长,小型运营商推迟采用。供应商必须提供融资选项或分阶段部署以减轻负担。由于这一障碍,中国数据中心热管理市场在中型数据中心中的渗透速度较慢。这限制了市场多样化,使先进系统集中于超大规模运营商。尽管长期节能,但对成本敏感的公司仍犹豫不决。

缺乏部署和维护下一代冷却技术的技术熟练劳动力

新型热技术需要专业培训以确保安全和高效运行。现场技术人员必须了解流体动力学、压力调节和浸没系统处理。中国的数据中心繁荣超过了冷却专注人员的培训速度。区域参与者难以找到适合复杂热项目的人才。中国数据中心热管理市场需要供应商与职业机构之间更强的合作。有限的专业知识导致次优安装或低效配置。项目时间表的延误和更高的维护错误增加了运营风险。弥合这一技能差距对于支持高密度冷却的采用至关重要。

市场机会

中国西部新兴数据中心区域提供有利的气候和可再生能源获取

甘肃、贵州和内蒙古等地区的新数据中心走廊提供自然冷却优势。这些地区保持较低的环境温度,减少了对机械冷却的依赖。水电的可用性使低排放操作成为可能。中国数据中心热管理市场在这些气候中找到本地化热系统的机会。专注于被动和环境冷却的供应商获得先发优势。政府支持进一步降低了这些区域项目融资的风险。

与东南亚和中东数据中心运营商的出口和合作机会

中国冷却供应商在新兴数字经济中探索外向机会。印度尼西亚、阿联酋和沙特阿拉伯等国家寻求经济实惠且可扩展的热系统。中国数据中心热管理市场可以出口模块化硬件和软件包。与国际托管公司合作可实现足迹扩展。区域定制和成本竞争力推动海外增长。

市场细分

按数据中心规模

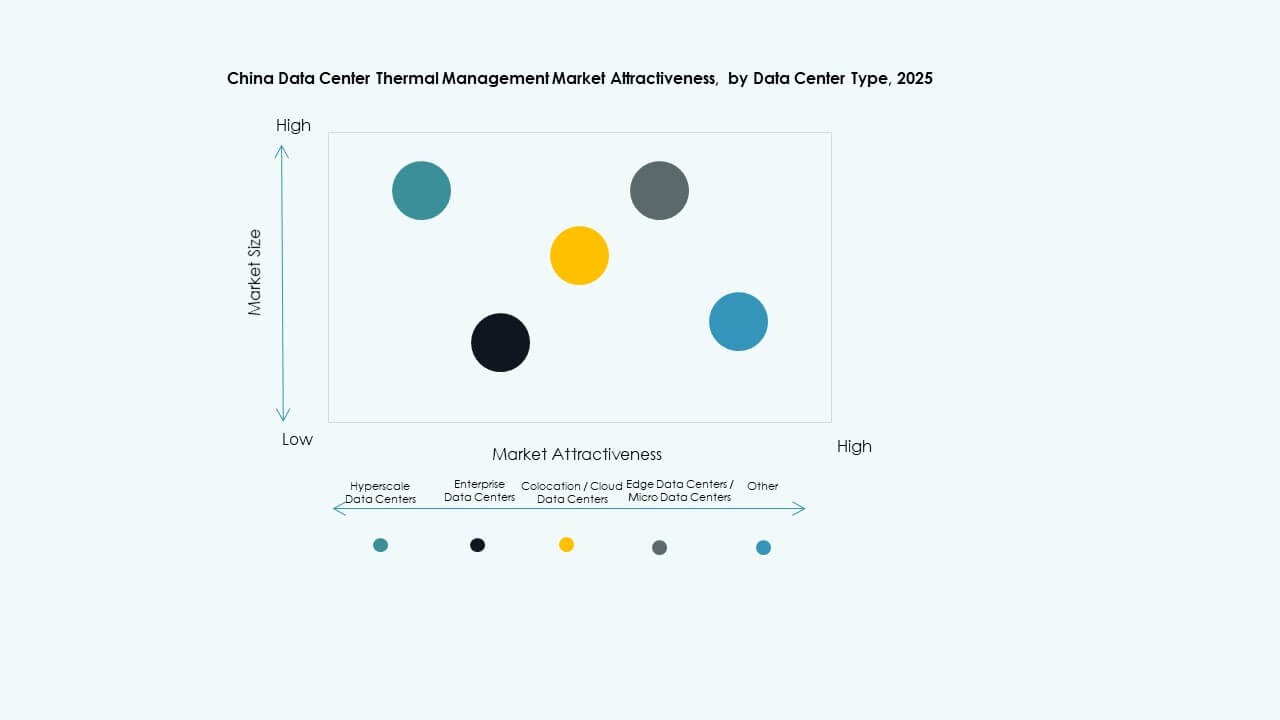

由于云服务提供商的大规模投资,大型数据中心在中国数据中心热管理市场中占据主导地位。这些设施的每个机架功率为20 kW或更高,需要高效、可扩展的冷却系统。中型数据中心也在稳步增长,受到企业采用混合云策略的推动。小型数据中心的市场份额较小,但受益于适合改造的模块化冷却系统,支持城市边缘部署。

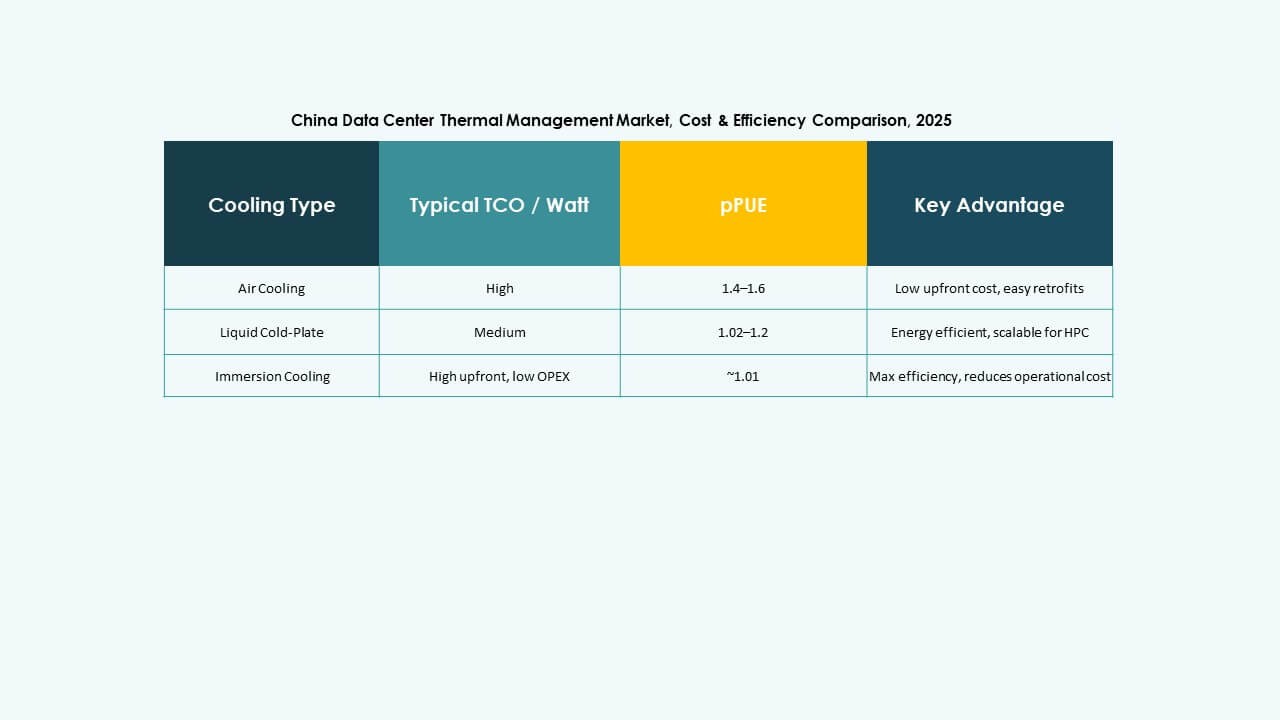

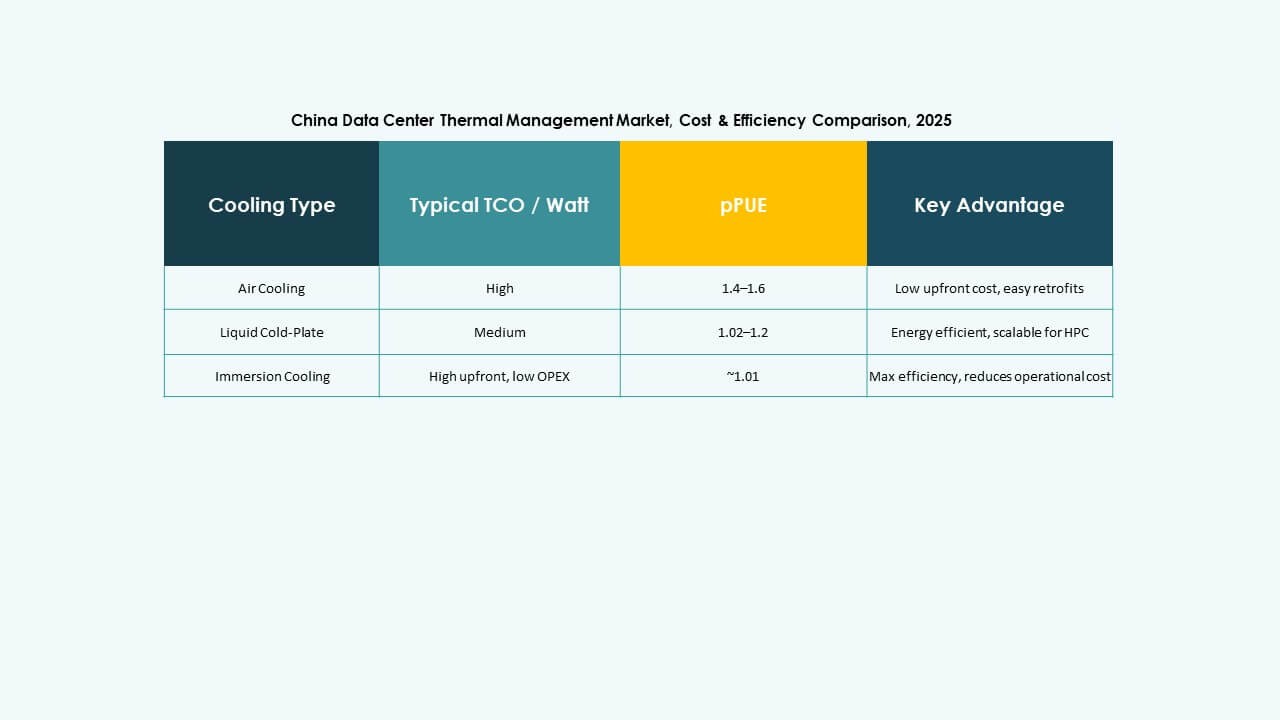

按冷却技术

空气冷却在传统设置中仍占主导地位,尤其是热/冷通道和直接空气解决方案。然而,液体冷却正在快速增长,特别是在AI密集环境中的直接芯片冷却和浸没式冷却。混合系统在改造和过渡站点中获得关注。后门液体冷却在GPU丰富的环境中受到青睐,而热电和相变是具有高潜力的边缘和微型数据中心的创新技术。

按组件

硬件引领该细分市场,占据中国数据中心热管理市场的最大份额。冷却单元、风扇和热交换器始终有需求。由于DCIM、AI优化和CFD工具在高密度环境中变得必不可少,软件正在增长。由于基础设施老化和监管要求的变化,调试、维护和升级等服务获得动力。

按硬件

冷却单元和冷水机组占据最高份额,其次是热交换器和气流设备。风扇和管道系统在传统和现代建筑中都至关重要。增长由紧凑、模块化的硬件解决方案推动。其他组件如机架级冷却液循环和变速风扇因性能驱动的运营商需求而增加。

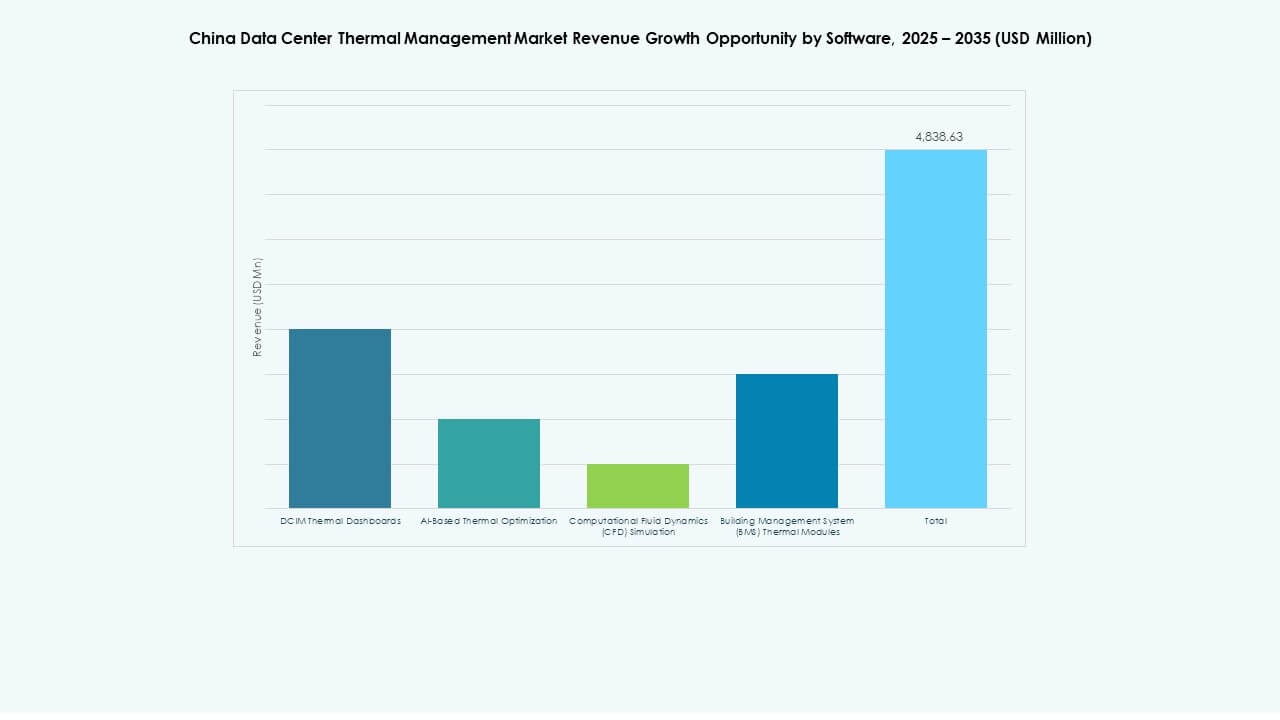

按软件

AI优化和DCIM仪表板在软件采用中领先,用于实时控制和节能。CFD模拟用于设计阶段的气流规划。BMS模块在智能建筑集成中很重要。增长由软件降低冷却成本和提高正常运行时间的能力驱动。它将被动系统转变为智能网络。

按服务

预防性维护和安装服务占主导地位,特别是在超大规模和城市共址站点。随着运营商寻求供应商管理的热管理,改造和监控作为服务增长。在转向AI或云应用的旧站点中,升级变得必不可少。提供捆绑服务合同的供应商确保了经常性收入。

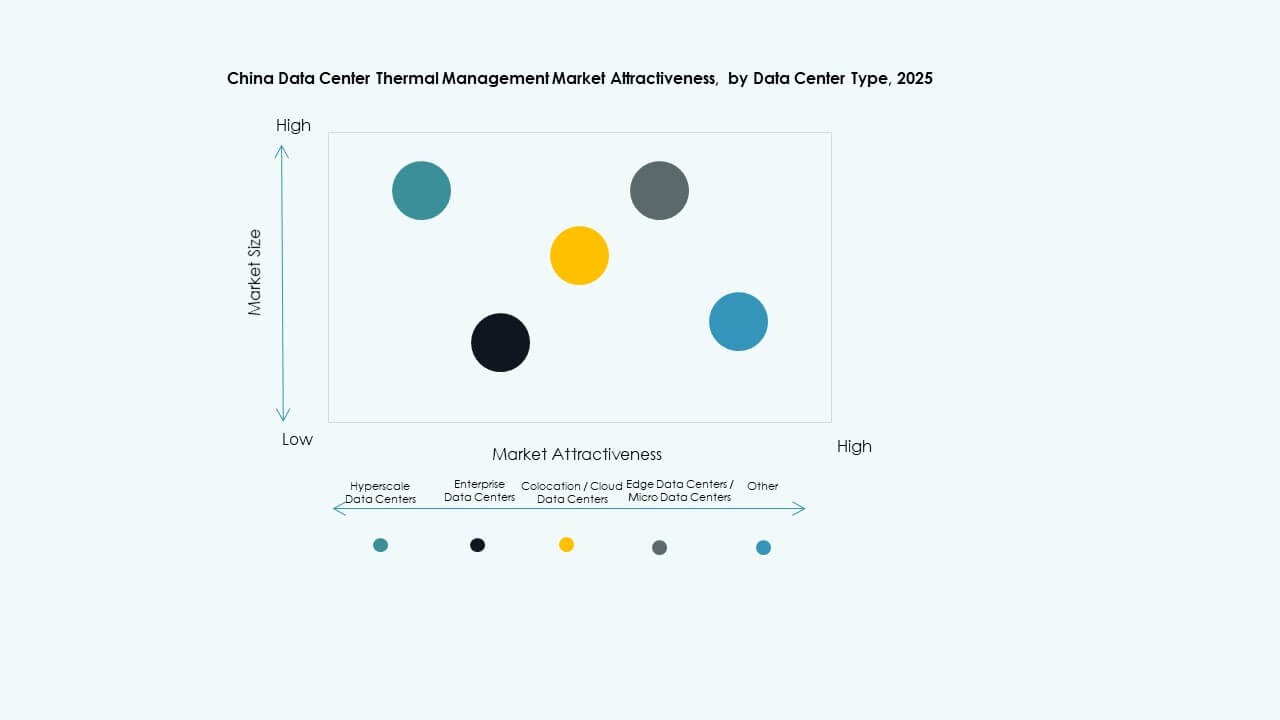

按数据中心类型

超大规模设施在中国数据中心热管理市场中占据最大份额,受到公共云扩展的推动。共址和云数据中心紧随其后,国内外提供商的稳定投资推动其发展。由于制造和物流中AI和物联网的采用,企业和边缘部署增长。其他类型包括具有独特热需求的政府和研究设施。

按结构

基于房间的冷却在传统建筑中仍然常见,但基于机架和基于行的系统在效率和空间优化方面领先。基于机架的解决方案支持高密度计算和AI工作负载。基于行的系统允许在模块化区域内进行有针对性的气流。趋势转向结构集成系统,而不是整个房间的设置。

区域见解

由于托管和企业数据中心的高密度,华东地区主导市场份额

华东地区,包括江苏、浙江等省份以及上海和北京等城市,占中国数据中心热管理市场的40%以上。这些地区拥有大多数企业IT基础设施和托管设施。高人口密度、靠近企业总部以及更好的连接性推动了集中化。随着机架密度的增加和低PUE合规要求,先进热系统的需求上升。主要企业在大型园区运营AI工作负载,推动了对先进液体和混合系统的需求。

- 例如,嘉实多和施耐德电气于2025年4月在上海开设了一个液体冷却联合实验室,将冷却液与冷却分配单元结合,以提高散热效率。

华北和华南在政府支持和AI扩展下成为增长区域

河北、天津等北方地区和深圳、广州等南方中心共同持有约35%的市场份额。这些地区受益于强大的科技行业存在和数据政策改革。华南地区见证了快速的超大规模增长,而北方地区则与国家计算资源重新分配保持一致。两个地区都优先推出AI数据中心,创造了对高性能冷却系统的需求。环境条件各异,促使根据当地温度和湿度特征定制冷却解决方案。这些地区的城市改造项目支持模块化和机架式热设计。

- 例如,施耐德电气于2025年推出其EcoStruxure™ Pod数据中心,每个Pod支持高达1 MW的集成液体冷却,以满足高密度AI集群需求。模块化设计增强了加速计算工作负载的部署灵活性。

西部和中部中国凭借适宜的气候条件提供战略扩展潜力

贵州、甘肃和重庆等西部和中部省份共同贡献了中国数据中心热管理市场的约25%。这些地区在“东数西算”政策中被定位为可持续数据处理的目标。较低的环境温度支持空气经济化,而可用土地则促进超大规模发展。可再生能源的可用性增强了绿色数据中心的吸引力。运营商部署间接蒸发和被动冷却系统。这里的市场增长与国家碳中和目标和跨区域基础设施投资保持一致。

竞争洞察:

- Vertiv 集团公司

- 施耐德电气

- 大金工业株式会社

- 台达电子工业股份有限公司

- 华为技术有限公司

- 江森自控国际公司

- 三菱电机株式会社

- Munters 集团 AB

- Rittal 有限责任公司 & 合伙公司 KG

- Airedale 国际空调有限公司

中国数据中心热管理市场的竞争格局显示出全球和本地企业之间的激烈竞争,拥有多样化的专业知识。Vertiv 和施耐德通过为超大规模客户量身定制的全面热管理产品组合保持高份额。大金和台达专注于节能硬件和本地服务网络。华为将热管理解决方案与数字基础设施堆栈集成,为企业客户提供服务。江森自控和三菱电机将广泛的 HVAC 能力引入数据中心领域。Munters 和 Rittal 通过模块化系统满足高密度需求。Airedale 在中型设施中推动产品升级。公司在研发上投入大量资金,以改进液体、混合和 AI 驱动的控制。与云和托管公司合作推动安装管道。企业还寻求服务合同,以确保经常性收入流并增强客户保留率。

最新动态:

- 2025年11月,大金工业株式会社的子公司 Daikin Applied 收购了 Chilldyne,这是一家专注于高性能 AI 数据中心负压液冷的专业公司。该交易补充了之前的收购,并通过直接芯片冷却集成增强了大金在超大规模数据中心的产品组合。

- 2025年11月,LG 电子与 Flex 合作开发模块化冷却解决方案,将 LG 的空气和液体冷却基础设施与 Flex 的电力和 IT 系统相结合。此次合作旨在解决 AI 时代千兆瓦级数据中心的热管理挑战。

- 2025年11月,伊顿公司签署了一项最终协议,以95亿美元收购高性能液冷领域的领导者 Boyd Thermal。此次收购通过将 Boyd 的冷却技术与伊顿的电力管理专业知识相结合,解决了激增的 AI 数据中心热需求。

- 2025年8月,大金工业株式会社收购了 Dynamic Data Centers Solutions, Inc.(DDC Solutions),这是一家创新冷却技术的领导者,专注于 AI 数据中心。此举通过整合 DDC 的服务器机架级空调和实时电力管理系统,增强了大金在数据中心市场的竞争力。

- 2025年3月,施耐德电气推出了与 NVIDIA 联合设计的 132 kW 液冷 AI 机架参考设计,支持中国不断增长的数据中心基础设施中的高密度计算。