Riassunto esecutivo:

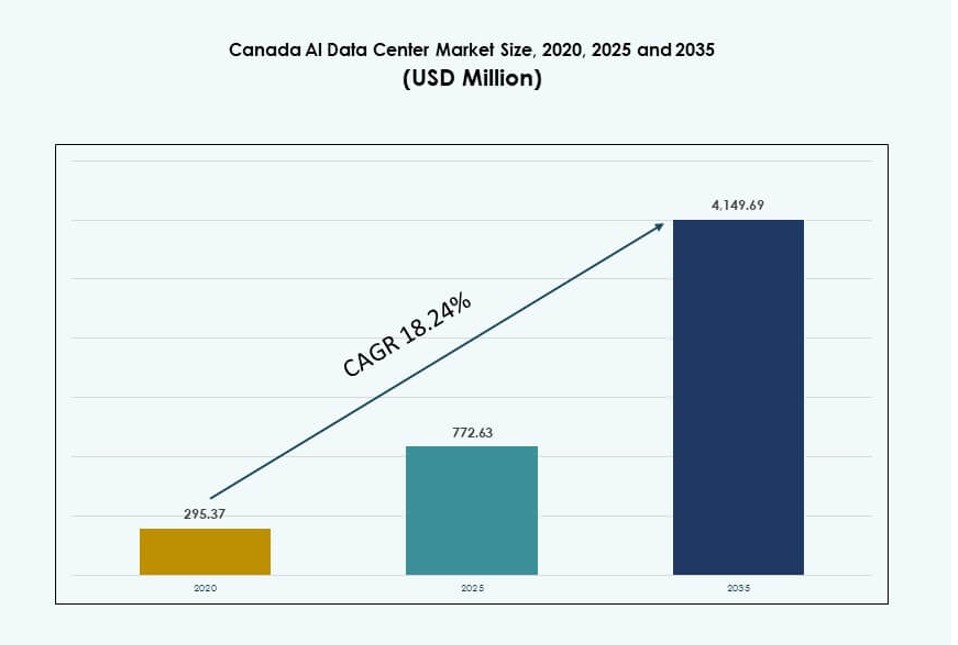

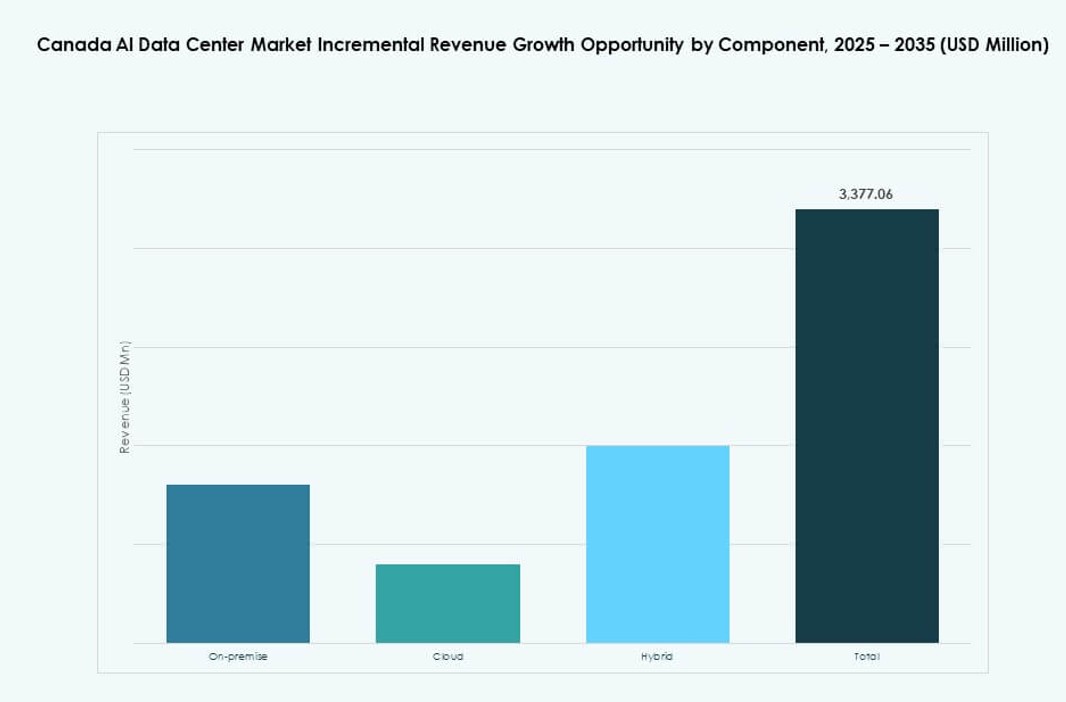

La dimensione del mercato dei Data Center AI in Canada è stata valutata a 295,37 milioni di USD nel 2020, raggiungendo i 772,63 milioni di USD nel 2025 e si prevede che raggiungerà i 4.149,69 milioni di USD entro il 2035, con un CAGR del 18,24% durante il periodo di previsione.

| ATTRIBUTO DEL RAPPORTO |

DETTAGLI |

| Periodo Storico |

2020-2023 |

| Anno Base |

2024 |

| Periodo di Previsione |

2025-2035 |

| Dimensione del Mercato dei Data Center AI in Canada 2025 |

772,63 Milioni di USD |

| Mercato dei Data Center AI in Canada, CAGR |

18,24% |

| Dimensione del Mercato dei Data Center AI in Canada 2035 |

4.149,69 Milioni di USD |

Il mercato è guidato dalla crescente domanda di calcolo ad alte prestazioni, dall’adozione rapida di modelli AI generativi e dall’aumento della distribuzione di infrastrutture accelerate da GPU. Gli operatori stanno investendo in raffreddamento a liquido, orchestrazione avanzata e configurazioni di rack densi per supportare i carichi di lavoro di addestramento e inferenza AI. Gli incentivi governativi e gli obiettivi di sostenibilità stanno spingendo l’adozione di strutture alimentate da energia pulita. I fornitori di cloud, i venditori di hardware e gli operatori locali stanno espandendo le loro presenze per soddisfare le esigenze specifiche dell’AI. L’agilità dell’infrastruttura e l’efficienza energetica sono diventati fattori decisionali chiave. Il mercato offre forti ritorni sugli investimenti attraverso distribuzioni scalabili.

L’Ontario e il Quebec guidano il mercato grazie all’abbondante energia rinnovabile, ai bassi costi energetici e alla vicinanza a clienti aziendali e hub di ricerca AI. Toronto e Montreal sono emerse come zone centrali hyperscale che supportano cluster AI nazionali. L’Alberta è una regione emergente, guadagnando attenzione per il suo clima favorevole al raffreddamento e recenti investimenti su larga scala. La British Columbia supporta distribuzioni edge legate a industrie locali e applicazioni AI. Queste variazioni regionali riflettono la disponibilità di energia, la connettività di rete e il supporto politico. Creano una base di infrastrutture AI nazionali distribuite ma integrate.

Dinamiche di Mercato:

Fattori di Mercato

Crescente Integrazione di Carichi di Lavoro AI ad Alta Densità tra Strutture Hyperscale e Aziendali

Gli operatori hyperscale e le grandi imprese stanno espandendo i carichi di lavoro intensivi di GPU, richiedendo densità di rack più elevate. I modelli di addestramento AI richiedono rack che superano i 30 kW per armadio, spingendo gli aggiornamenti infrastrutturali. Il mercato dei Data Center AI in Canada supporta diversi casi d’uso AI tra NLP, CV e GenAI. Le strutture stanno adottando sistemi di raffreddamento avanzati e distribuzione intelligente dell’energia per gestire i carichi termici. I server AI ad alta densità accelerano il passaggio dall’infrastruttura IT tradizionale. La prontezza AI è diventata una metrica chiave nella selezione dei siti e nella progettazione delle strutture. Le aziende investono in architetture scalabili per garantire prestazioni continue. Le distribuzioni strategiche supportano gli obiettivi nazionali di adozione AI e la trasformazione intersettoriale. Ciò guida investimenti infrastrutturali a lungo termine.

Finanziamenti Governativi e Incentivi Politici per l’IA che Guidano lo Sviluppo delle Infrastrutture

I programmi federali e provinciali forniscono sovvenzioni, incentivi fiscali e finanziamenti per lo sviluppo dell’ecosistema dell’IA. Le politiche enfatizzano la sovranità dei dati, l’energia pulita e l’innovazione sostenibile nell’IA. Questi programmi aumentano la fiducia degli investitori e accelerano il lancio delle strutture. Il mercato dei data center dell’IA in Canada beneficia di partenariati pubblico-privati focalizzati sulla ricerca e l’infrastruttura. Le designazioni di hub dell’IA in città come Montreal e Toronto incoraggiano la costruzione di strutture iperscalabili. Le espansioni del cloud pubblico si allineano con la strategia per l’IA sostenuta dal governo. La chiarezza delle politiche aiuta a semplificare i processi di approvazione e interconnessione della rete. Gli investitori vedono il clima normativo stabile del Canada come un vantaggio competitivo. Promuove la crescita delle infrastrutture potenziate dall’IA.

- Ad esempio, il governo del Quebec ha impegnato 100 milioni di CAD fino al 2025 per supportare l’infrastruttura dell’IA di Mila, aumentando la capacità di calcolo nazionale. L’iniziativa consente cluster GPU su larga scala, inclusi i sistemi NVIDIA H100, per la ricerca avanzata e l’addestramento dei modelli.

Forte Disponibilità di Energia Rinnovabile e Focus su Operazioni Sostenibili per l’IA

Le abbondanti risorse idroelettriche del Canada riducono i costi energetici e le impronte di carbonio nei data center dell’IA. Gli iperscaler scelgono siti canadesi per allinearsi con i mandati ESG globali. L’accesso all’energia verde supporta gli obiettivi di sostenibilità e i risparmi sui costi a lungo termine. Il mercato dei data center dell’IA in Canada attrae operatori in cerca di energia pulita senza compromettere le prestazioni. Regioni come il Quebec e la Columbia Britannica offrono vantaggi di basso PUE. Gli operatori impiegano raffreddamento a liquido e a porta posteriore per l’efficienza. Gli accordi di acquisto di energia a lungo termine garantiscono l’affidabilità della rete e tariffe fisse. L’energia pulita attira carichi di lavoro di addestramento dell’IA da clienti globali. Rafforza la posizione del Canada nelle infrastrutture sostenibili.

Espansione Edge e Regionale per Servire Casi d’Uso Localizzati dell’IA e Crescita del 5G

I data center edge e micro si stanno espandendo nelle città di livello II e III per supportare applicazioni IA a bassa latenza. L’imaging sanitario, l’analisi al dettaglio e i casi d’uso automobilistici richiedono prossimità agli utenti finali. Il mercato dei data center dell’IA in Canada supporta zone di calcolo regionali con nodi più piccoli e pronti per l’IA. Le infrastrutture localizzate aiutano a ridurre la congestione del backhaul e migliorare i tempi di risposta dell’inferenza. L’IA edge supporta le implementazioni emergenti del 5G e i servizi in tempo reale. I modelli distribuiti riducono il rischio e consentono una scalabilità modulare. I settori del commercio al dettaglio, bancario e pubblico guidano la domanda di edge regionale. I carichi di lavoro containerizzati dell’IA consentono modelli di distribuzione flessibili. Rafforza il panorama del calcolo edge in Canada.

- Ad esempio, Bell Canada ha distribuito GPU NVIDIA A100 nei suoi core edge 5G in Ontario e Quebec, supportando l’analisi in tempo reale in oltre 20 città. L’infrastruttura consente una latenza inferiore a 5 ms per applicazioni edge guidate dall’IA.

Tendenze di Mercato

Crescente Adozione di Sistemi di Raffreddamento a Liquido e Gestione Termica Diretta al Chip

Gli operatori stanno investendo in tecnologie di raffreddamento avanzate per supportare l’aumento delle densità di potenza dei rack. I sistemi di raffreddamento diretto al chip e ad immersione stanno diventando standard nelle nuove costruzioni AI. Il mercato dei data center AI in Canada sta assistendo a un maggiore impiego di raffreddamento a base liquida per ridurre il PUE. Queste tecnologie migliorano l’efficienza della gestione termica per carichi di lavoro AI densi. Gli hyperscaler stanno dando priorità all’innovazione nel raffreddamento nella pianificazione dei siti. Gli scambiatori di calore a porta posteriore e l’integrazione di piastre fredde vengono adottati su larga scala. Le strutture abbinano il raffreddamento a liquido con l’ottimizzazione del flusso d’aria e il monitoraggio in tempo reale. La selezione del sistema di raffreddamento ora influenza direttamente le prestazioni AI a livello di rack. Ridefinisce le strategie di progettazione delle strutture.

Spostamento verso modelli di distribuzione di data center AI modulari e prefabbricati

Tempi di distribuzione più rapidi stanno aumentando la domanda di infrastrutture modulari su misura per casi d’uso AI. I fornitori offrono unità prefabbricate con sistemi integrati di alimentazione, raffreddamento e rack. Il mercato dei data center AI in Canada vede un crescente utilizzo di sale dati containerizzate in zone remote o periferiche. Le costruzioni modulari riducono il tempo per la prontezza AI e diminuiscono il lavoro in loco. Le unità prefabbricate supportano la scalabilità a fasi per l’espansione delle GPU. Gli operatori utilizzano layout modulari per la ridondanza e l’isolamento dei carichi di lavoro. Questi design aiutano a soddisfare la domanda AI in rapida evoluzione senza revisioni complete delle strutture. Consente un’infrastruttura scalabile e ripetibile in più località.

Gestione dell’infrastruttura guidata dall’AI tramite strumenti DCIM e di manutenzione predittiva

Gli operatori delle strutture stanno adottando piattaforme di gestione dell’infrastruttura dei data center (DCIM) potenziate dall’AI. Questi strumenti forniscono visibilità in tempo reale su energia, flusso d’aria, salute dei rack e tracciamento degli asset. Il mercato dei data center AI in Canada sfrutta l’analisi predittiva per ridurre i tempi di inattività e migliorare l’efficienza. Il DCIM con modelli di machine learning consente un controllo intelligente del raffreddamento e un bilanciamento dell’energia. Gli avvisi automatici prevengono picchi termici nei rack ad alta densità. Gli strumenti AI ottimizzano la pianificazione della capacità e le prestazioni SLA. I dashboard in tempo reale migliorano la trasparenza per i clienti con carichi di lavoro AI. Migliora la gestione del ciclo di vita per asset infrastrutturali di alto valore.

Domanda di GPU-as-a-Service e posizionamento dei carichi di lavoro AI in modelli ibridi

I fornitori di servizi stanno offrendo piattaforme GPU-as-a-Service per clienti senza infrastruttura AI interna. Le imprese preferiscono modelli di distribuzione AI ibridi con accesso GPU sia on-prem che cloud. Il mercato dei data center AI in Canada supporta questo con colocation pronte per GPU e design cloud-native. Interconnessioni ad alta velocità e architetture basate su fabric consentono un posizionamento efficiente dei carichi di lavoro. La domanda di cluster GPU nativi di Kubernetes è in aumento tra gli sviluppatori. Gli operatori stanno integrando NVMe-over-Fabric e RDMA per supportare cicli di inferenza rapidi. Gli utenti AI richiedono flessibilità nell’orchestrazione dei carichi di lavoro e nella distribuzione multi-zona. Influenza il design dei rack, i livelli di rete e i modelli di servizio.

Sfide del mercato

Alti costi infrastrutturali e lunghi cicli di approvvigionamento per apparecchiature ottimizzate per AI

Implementare data center pronti per l’IA comporta investimenti costosi in GPU, raffreddamento a liquido e sistemi di alimentazione. I lunghi tempi di consegna per l’hardware ad alte prestazioni ritardano le costruzioni e gli aggiornamenti di capacità. Il mercato dei data center per l’IA in Canada affronta la pressione della competizione globale per chip e componenti. I fornitori di attrezzature danno priorità ai grandi clienti statunitensi o asiatici, riducendo la disponibilità per gli operatori canadesi. I costi delle strutture aumentano con configurazioni di rack densi e raffreddamento specializzato. I vincoli di budget influenzano gli operatori piccoli e medi che cercano aggiornamenti dell’infrastruttura IA. I ritardi nell’approvvigionamento interrompono le tempistiche dei progetti e l’onboarding degli inquilini. Le aziende devono bilanciare il CapEx con la futura domanda di IA. Ciò crea colli di bottiglia nel dispiegamento attraverso le regioni.

Ritardi nell’Interconnessione alla Rete e Vincoli di Distribuzione Energetica Regionale

Interconnettere data center IA ad alta densità alla rete locale pone ostacoli tecnici e normativi. Alcune regioni affrontano carenze di trasformatori o limiti di capacità delle sottostazioni. Il mercato dei data center per l’IA in Canada incontra ritardi nei progetti legati al coordinamento con le utility. La rapida crescita dell’IA mette pressione sull’infrastruttura di rete che non è stata progettata per un elevato consumo energetico. Le approvazioni di zonizzazione, le valutazioni ambientali e gli accordi con le utility estendono le tempistiche dei progetti. La congestione della rete nelle zone urbane limita l’espansione di carichi di lavoro GPU densi. Gli operatori esplorano configurazioni energetiche alternative, ma le normative rallentano l’implementazione. Ciò limita lo sviluppo rapido di nuovi hub IA.

Opportunità di Mercato

Cluster Nazionali di IA e Istituzioni di Ricerca che Guidano la Crescita Regionale

L’ecosistema dei cluster IA in Canada crea domanda per infrastrutture IA locali. Università, startup e laboratori di ricerca collaborano con i fornitori di data center. Il mercato dei data center per l’IA in Canada beneficia della vicinanza ai centri di eccellenza IA. Le collaborazioni accademiche e commerciali supportano una domanda di calcolo sostenuta. La crescita degli investimenti pubblici in IA consente il lancio di strutture regionali. Supporta l’adozione a lungo termine dell’IA in diversi settori.

Crescente Domanda di Carichi di Lavoro di Inferenza nei Settori BFSI e Retail

L’inferenza IA per il rilevamento delle frodi, la personalizzazione e i chatbot è in aumento tra le imprese. I clienti BFSI e retail cercano infrastrutture a bassa latenza nelle principali metropoli. Il mercato dei data center per l’IA in Canada consente l’inferenza quasi in tempo reale con rack pronti per GPU. La domanda di zone di distribuzione specifiche per l’inferenza apre nuove offerte di servizi. Ciò crea crescita oltre i grandi cluster di addestramento.

Segmentazione di Mercato

Per Tipo

Il segmento hyperscale domina il mercato dei data center per l’IA in Canada grazie alla domanda di cluster GPU su larga scala. Gli hyperscaler implementano rack densi che supportano l’addestramento di modelli IA e servizi cloud IA. Le strutture di colocation e Impresa seguono, servendo esigenze IA ibride e private. I data center edge e micro stanno emergendo per supportare l’inferenza IA sensibile alla latenza. Questi nodi più piccoli espandono la portata dell’IA nelle regioni non metropolitane. La crescita in tutti i tipi si allinea con la complessità dei modelli IA e la diversità dei casi d’uso.

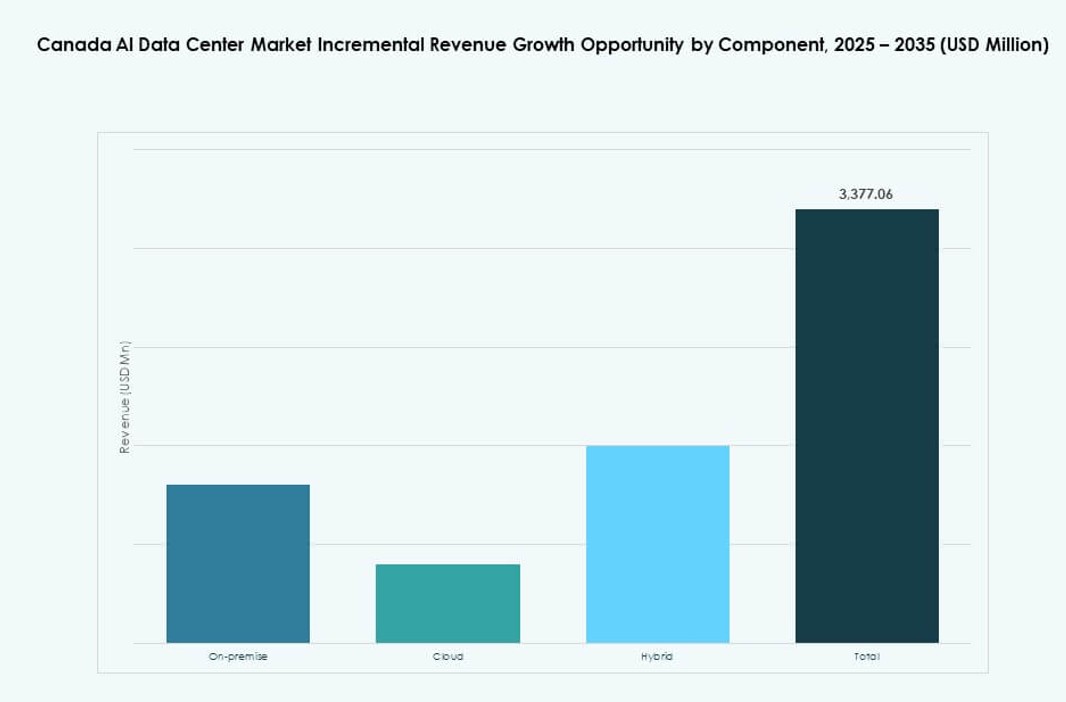

Per Componente

L’hardware guida il mercato, trainato da server GPU, rack ad alta densità e sistemi di raffreddamento. Gli operatori investono pesantemente in hardware ad alta intensità di calcolo per supportare i carichi di lavoro AI. Software e strumenti di orchestrazione crescono rapidamente poiché gli utenti AI cercano la portabilità dei carichi di lavoro. I servizi contribuiscono al deployment, al monitoraggio e alla gestione del ciclo di vita. DCIM, orchestrazione AI e piattaforme di gestione ibrida consentono una scalabilità agile. Insieme, questi componenti formano uno strato di infrastruttura AI strettamente integrato.

Per Deployment

Il cloud rimane dominante grazie alla sua flessibilità, scalabilità e accesso alle risorse GPU. Gli hyperscaler espandono le offerte AI nelle zone di cloud pubblico. I deployment ibridi sono in aumento poiché le imprese mantengono i carichi di lavoro sensibili on-premise. I modelli ibridi supportano la conformità, il controllo dei costi e la personalizzazione dei modelli AI. Il deployment on-premise mantiene ancora rilevanza nei settori regolamentati. Ogni modello si rivolge a diversi livelli di maturità AI e casi d’uso.

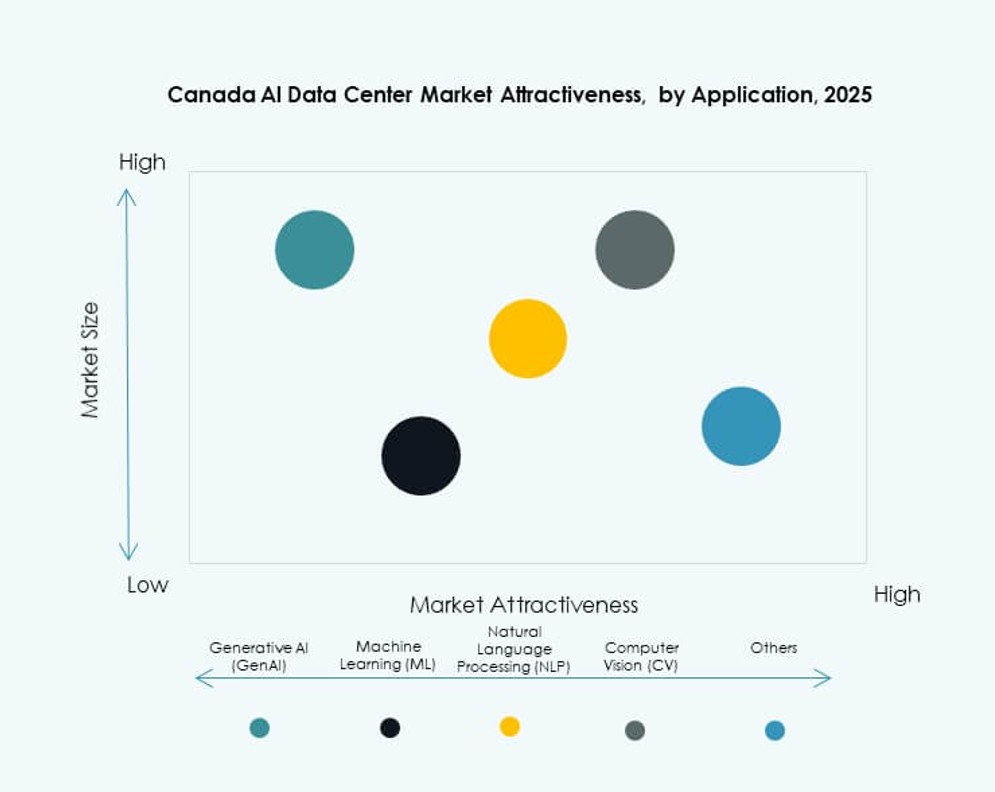

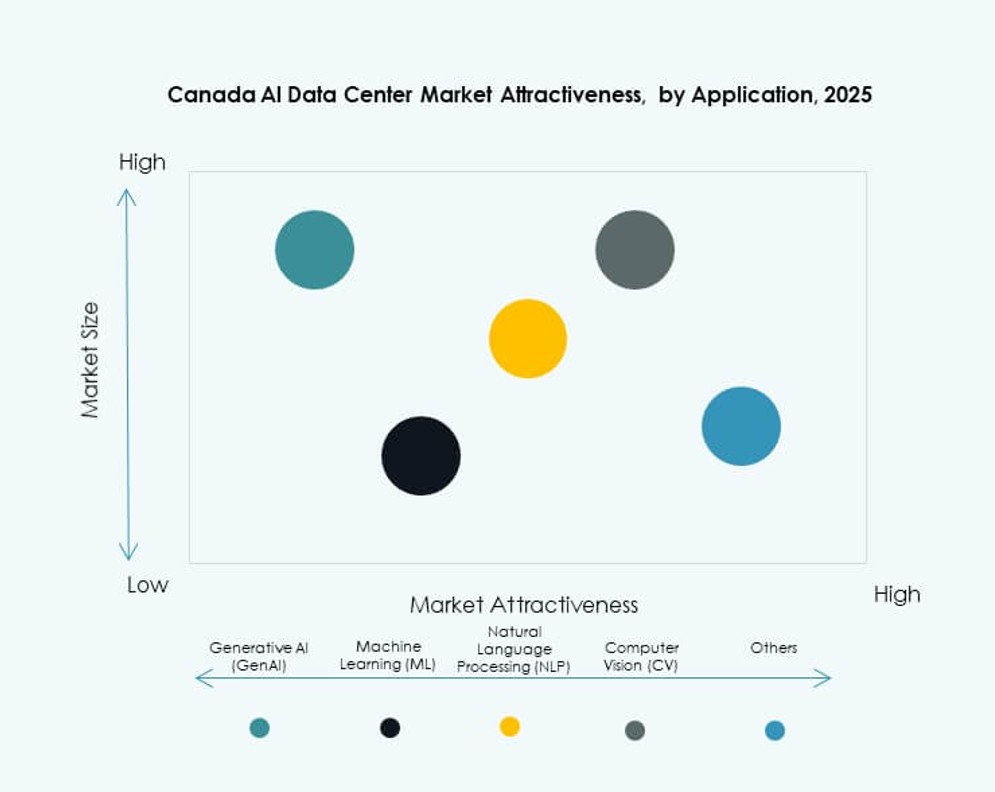

Per Applicazione

Il machine learning detiene la quota maggiore, trainato da analisi predittive e modellazione dei dati. L’AI generativa vede una rapida crescita con l’adozione aziendale di LLM. La visione artificiale e l’NLP stanno crescendo nei settori sanitario, automobilistico e nelle implementazioni di città intelligenti. Altre applicazioni includono motori di raccomandazione e sistemi di rilevamento delle frodi. Il mercato dei Data Center AI in Canada supporta tutti i carichi di lavoro con infrastruttura ottimizzata per GPU. La diversità dello stack AI guida la personalizzazione di rack e raffreddamento.

Per Settore

IT e telecom dominano, trainati dalle esigenze infrastrutturali per la fornitura di servizi AI. BFSI e retail seguono da vicino, adottando AI per il rilevamento delle frodi e la personalizzazione. La sanità utilizza AI per diagnostica e imaging medico. I media e l’intrattenimento richiedono AI per la generazione di contenuti e l’ottimizzazione dello streaming. I settori manifatturiero e automobilistico utilizzano AI per l’automazione e la manutenzione predittiva. La diversità settoriale supporta una crescita sostenuta attraverso i casi d’uso.

Approfondimenti Regionali

Ontario Guida la Capacità Nazionale con Toronto come Principale Hub di Infrastruttura AI

L’Ontario detiene oltre il 42% della quota del mercato dei Data Center AI in Canada. Toronto è leader grazie al suo talento tecnologico, connettività e regolamentazioni sui dati. Gli hyperscaler e le istituzioni finanziarie scelgono Toronto per la vicinanza agli utenti e ai centri di ricerca AI. Il supporto governativo e l’accesso a energia pulita consentono una densa infrastruttura GPU. La regione continua ad attrarre investimenti in cloud e colocation. Rimane il mercato centrale per i deployment guidati dall’AI.

- Ad esempio, il governo canadese ha annunciato un investimento di 240 milioni di dollari canadesi nel dicembre 2024 per supportare l’espansione del data center di Cohere a Toronto, con operazioni che inizieranno nel 2025 per aumentare la capacità di calcolo AI.

Quebec Guadagna Trazione con Energia Rinnovabile e Prezzi Competitivi dell’Elettricità

Il Quebec rappresenta quasi il 28% del mercato, offrendo abbondante energia idroelettrica. I suoi bassi tassi energetici supportano i carichi di lavoro AI che richiedono un input di potenza massiccio. Montreal è diventata una zona preferita per i cluster di addestramento AI su larga scala. I programmi provinciali incoraggiano infrastrutture sostenibili allineate con gli obiettivi ESG globali. I fornitori di colocation espandono le strutture pronte per l’AI vicino agli asset della rete esistente. Posiziona il Quebec come un hub di infrastruttura AI verde.

Le Province Occidentali e Atlantiche Emergono con Implementazioni Edge e Casi d’Uso Settoriali Specifici

Alberta e British Columbia sono regioni in crescita con centri di intelligenza artificiale edge vicino a poli energetici, sanitari e commerciali. Insieme, le province occidentali detengono circa il 20% della quota di mercato. L’elaborazione localizzata dei dati per robotica, diagnostica e logistica guida l’adozione. Le politiche di energia pulita della British Columbia sono in linea con le esigenze delle infrastrutture AI. La regione atlantica sta emergendo attraverso partenariati di ricerca pubblico-privati e progetti di connettività rurale. Supporta la crescita delle infrastrutture AI distribuite.

- Ad esempio, AWS ha impegnato 17,9 miliardi di dollari per espandere la sua infrastruttura cloud canadese, con investimenti in corso focalizzati sul miglioramento delle capacità AI e di calcolo attraverso la sua regione Canada (Central) con sede a Montreal. L’iniziativa supporta l’infrastruttura digitale nazionale e la domanda di carico di lavoro dalle province occidentali.

Approfondimenti Competitivi:

- eStruxture Data Centers

- QScale

- Cologix

- Microsoft (Azure)

- Amazon Web Services (AWS)

- Google Cloud

- Meta Platforms

- NVIDIA

- Equinix

- Digital Realty Trust

Il mercato dei Data Center AI in Canada è competitivo, con una forte partecipazione di fornitori cloud globali e operatori domestici. I grandi operatori come AWS, Microsoft e Google guidano importanti investimenti in infrastrutture pronte per GPU per supportare i carichi di lavoro AI. Aziende locali come QScale ed eStruxture si concentrano sulla copertura regionale, sostenibilità e consegna a bassa latenza. Meta e NVIDIA contribuiscono alla domanda attraverso il dispiegamento di cluster AI e la fornitura di hardware. Gli operatori di colocation come Equinix e Digital Realty espandono la capacità per i clienti AI che cercano modelli ibridi. I fornitori di hardware come Dell, HPE e Lenovo consentono una rapida scalabilità delle infrastrutture. È modellato dalla specializzazione, disponibilità regionale e supporto per l’addestramento e l’inferenza AI. Gli operatori competono su efficienza energetica, densità di rack, prestazioni di raffreddamento e conformità alle normative sui dati.

Sviluppi Recenti:

- Nel dicembre 2025, Microsoft ha annunciato un investimento storico di 19 miliardi di dollari canadesi (inclusi oltre 7,5 miliardi di dollari canadesi nei prossimi due anni) per espandere le sue regioni di datacenter Azure Canada Central e Canada East per l’infrastruttura AI, con nuova capacità disponibile alla fine del 2026

- Nel luglio 2025, eStruxture Data Centers ha ottenuto un finanziamento rivoluzionario di 1,35 miliardi di dollari canadesi, inclusa la prima cartolarizzazione di data center con solo asset valutati in Canada, per accelerare lo sviluppo di data center pronti per l’AI in tutto il paese.

- Nell’ottobre 2024, eStruxture Data Centers ha confermato i piani per un data center da 750 milioni di dollari canadesi (585 milioni di dollari USA) da 90 MW vicino a Calgary, progettato per supportare carichi di lavoro AI generativi e cloud, segnando una significativa espansione nell’infrastruttura AI dell’Alberta.